L’intelligence artificielle générative (ChatGPT, Midjourney, DALL‑E, etc.) est en train de transformer notre manière de créer, travailler et communiquer. Mais cette montée en puissance s’accompagne de nouveaux défis pour la sécurité et la protection des données personnelles. Entre historiques de conversations, prompts sensibles et images générées, nos informations peuvent devenir vulnérables à des usages non souhaités.

Dans cet article, vous découvrirez :

Les principaux risques liés à l’usage des IA génératives

Comment les utiliser de manière plus sûre

Des bonnes pratiques pour protéger vos fichiers, images et historiques

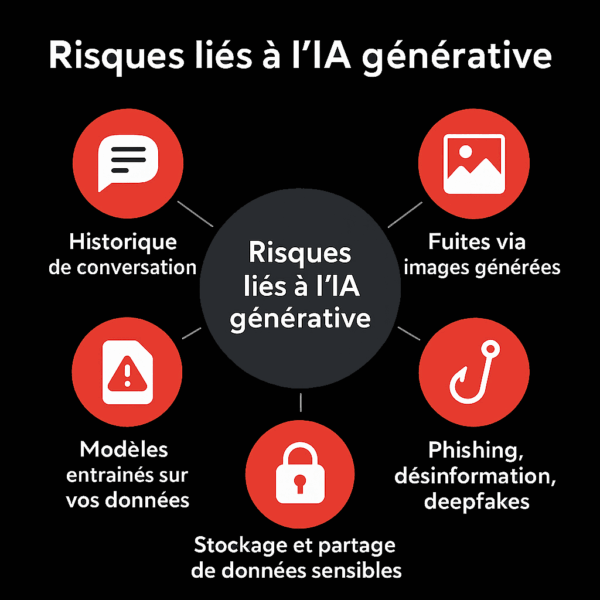

1. Risques principaux à connaître

Stockage et partage de données sensibles

Beaucoup d’IA nécessitent de fournir des prompts ou des contextes. Si vous incluez des données personnelles (adresse, identifiants, informations confidentielles), elles peuvent être exploitées.Historique de conversation

Les plateformes d’IA gardent souvent un historique — cela peut exposer des données sensibles si votre compte est compromis, si vous utilisez un appareil partagé, etc.Modèles entraînés sur vos données

Certains services peuvent réutiliser les données des utilisateurs pour entraîner de futurs modèles — penser à ce que vous partagez.Fuites via images générées

Les images que vous générez peuvent contenir des métadonnées (géolocalisation, données EXIF), ou bien être utilisées sans votre permission une fois publiées.Phishing, désinformation, deepfakes

L’IA permet aussi de créer des contenus très réalistes. Il faut être capable de distinguer le vrai du faux, et se protéger.

2. Bonnes pratiques pour sécuriser vos données avec l’IA

Limiter les informations personnelles dans les prompts

Ne donnez que ce qui est nécessaire. Évitez d’inclure des identifiants, adresse, date de naissance, etc.Utiliser des comptes séparés / privés

Si possible, créez un compte dédié pour vos usages privés vs professionnels, pour séparer les données.Vérifier les politiques de confidentialité des outils d’IA

Est-ce que les données de l’utilisateur sont conservées ? Réutilisées pour l’entraînement ? Supprimables sur demande ?Nettoyer vos historiques régulièrement

Supprimez les conversations / prompts inutiles. Effacez les images ou documents téléchargés.Protéger vos fichiers générés

Pour les images ou documents sensibles, stockez-les localement ou sur des services chiffrés. Supprimer les métadonnées avant partage.Utiliser les réglages de sécurité

Authentification à deux facteurs (2FA), mots de passe forts, logiciels de sécurité / antivirus, accès sécurisé à vos appareils.

3. Outils et astuces pratiques

Outils de suppression des données personnelles

Services ou scripts permettant de supprimer vos prompts ou conversations des serveurs si l’outil le propose.Extensions / logiciels qui anonymisent les métadonnées

Par exemple, pour les images, utilisez des outils pour retirer les données EXIF. Pour les documents, éviter d’inclure info cachées.Utilisation d’IA en local

Si possible, privilégier des modèles open source que vous hébergez vous-même, afin de garder le contrôle total sur vos données.Chiffrement

Chiffrez vos fichiers sensibles, utilisez des services de stockage chiffrés. Même le message ou document partagé peut être chiffré.

L’IA générative offre des opportunités immenses, mais aussi de nouveaux risques pour la vie privée. En adoptant quelques réflexes simples — limiter ce que vous partagez, vérifier les politiques de confidentialité, nettoyer vos historiques, chiffrer vos fichiers — vous pouvez profiter de ces outils tout en protégeant vos données. Si vous avez un doute, mieux vaut ne pas partager.